サーチコンソールAPIを活用することで、Webサイトの検索パフォーマンスデータを自動で取得し、SEO施策に役立てることができます。手動でのデータ確認には限界があり、大量のデータを効率的に分析するためにはAPIの活用が欠かせません。本記事では、サーチコンソールAPIの基本的な仕組みから実際の設定方法、SEOへの具体的な活用術まで徹底的に解説します。初めてAPIを扱う方でも理解できるよう、ステップバイステップで説明していきますので、ぜひ最後までご覧ください。

- サーチコンソールAPIの基本と導入方法

Google Cloud Consoleでの設定から認証情報の取得まで、初心者でも迷わず進められる手順を解説しています

- APIを使った検索データの取得方法

Pythonを活用した実践的なコード例とともに、効率的なデータ取得の方法を紹介しています

- 取得データをSEO施策に活かす分析術

クリック率改善やキーワード戦略の見直しなど、具体的なSEO活用事例を解説しています

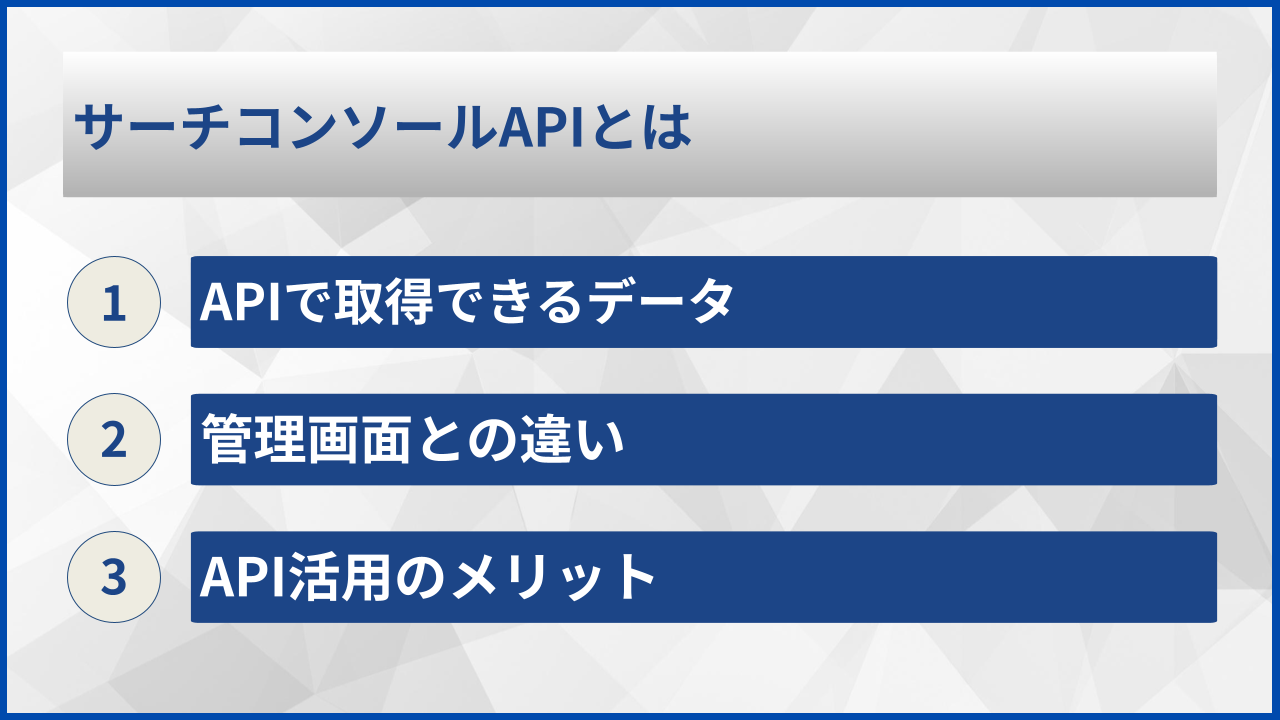

サーチコンソールAPIとは

APIで取得できるデータ

サーチコンソールAPIでは、検索アナリティクスデータを中心に、サイトのインデックス状況やURL検査結果なども取得できます。具体的には、クエリ(検索キーワード)、ページURL、デバイス、国、日付ごとのクリック数、表示回数、CTR、掲載順位などが含まれます。

これらのデータは最大16ヶ月分まで遡って取得可能です。管理画面では一度に確認できるデータ量に制限がありますが、APIを使えばより詳細な分析が行えます。

管理画面との違い

APIと管理画面の最大の違いは、データの取得方法と処理の自動化にあります。管理画面ではエクスポート機能を使って手動でダウンロードする必要がありますが、APIならスクリプトを実行するだけで自動取得できます。

また、管理画面では1,000行までしかエクスポートできませんが、APIではページネーションを活用することで、より多くのデータにアクセスできます。大規模サイトの分析には、APIの活用が効果的です。

API活用のメリット

サーチコンソールAPIを活用する最大のメリットは、データ取得と分析の効率化です。毎日のレポート作成や週次の順位変動チェックを自動化することで、本来注力すべき施策立案や改善作業に時間を使えるようになります。

さらに、取得したデータを他のツールやデータソースと組み合わせることで、より深い分析が可能になります。Google Analyticsのデータと連携させれば、流入キーワードとコンバージョンの関係性も把握できるでしょう。

| 比較項目 | 管理画面 | API |

|---|---|---|

| データ取得方法 | 手動エクスポート | 自動取得可能 |

| 取得行数制限 | 1,000行まで | 制限緩和 |

| 複数サイト対応 | 個別に確認 | 一括取得可能 |

| 定期実行 | 不可 | スケジュール実行可能 |

このように、APIを活用することでデータ活用の幅が大きく広がります。次のセクションでは、実際にAPIを利用するための準備手順を説明していきます。

サーチコンソールAPIは、SEOデータ分析を効率化する強力なツールです。まずは基本を押さえておきましょう

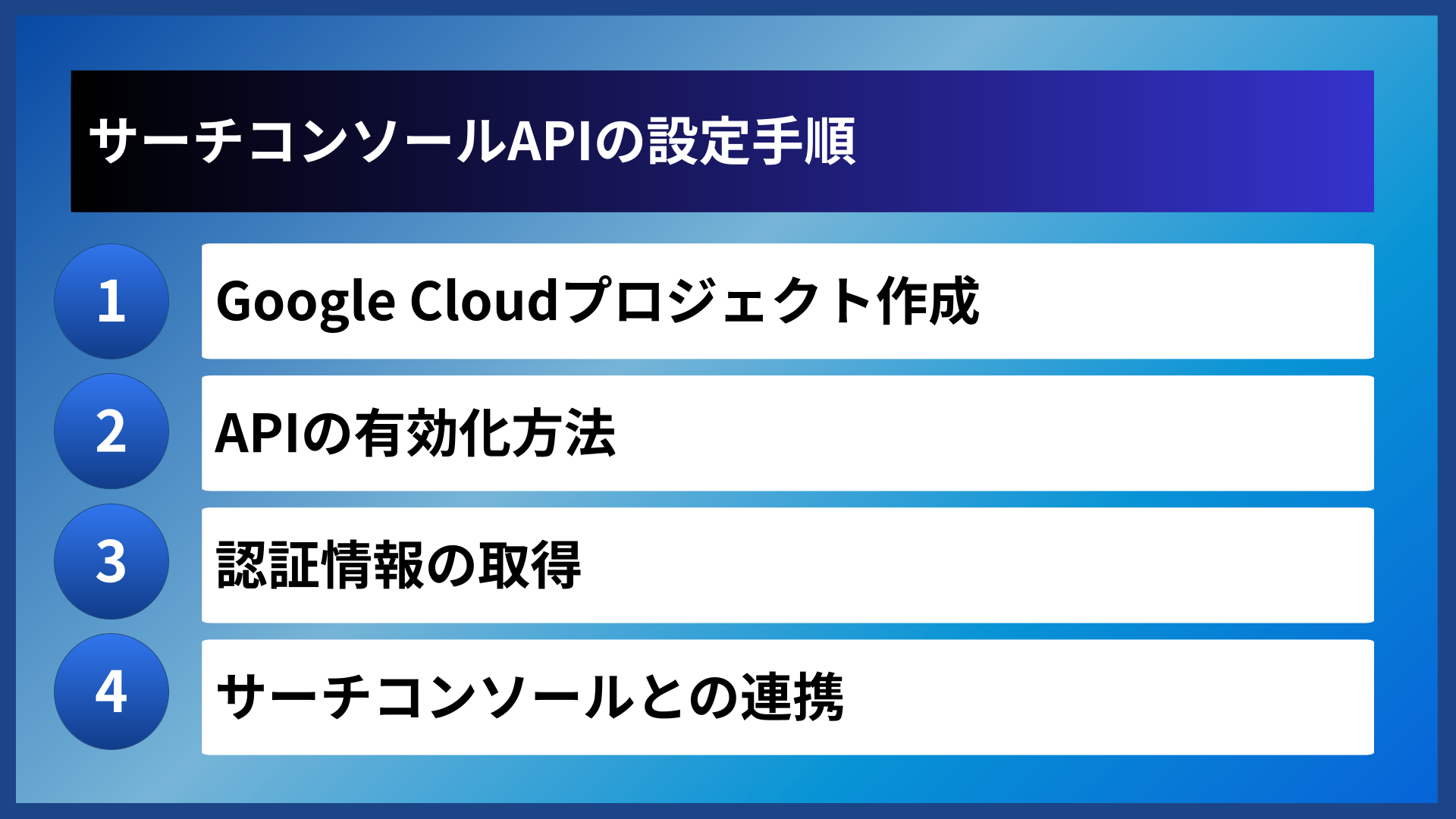

サーチコンソールAPIの設定手順

Google Cloudプロジェクト作成

まずはGoogle Cloud Consoleにアクセスし、新規プロジェクトを作成します。Googleアカウントでログイン後、コンソール画面上部のプロジェクト選択メニューから「新しいプロジェクト」をクリックします。

プロジェクト名は任意で設定できますが、後から識別しやすい名前を付けておくと管理が楽になります。組織アカウントの場合は適切な組織を選択してください。

APIの有効化方法

プロジェクト作成後、Search Console APIを有効化する必要があります。左側メニューの「APIとサービス」から「ライブラリ」を選択し、検索窓に「Search Console API」と入力して検索します。

表示されたAPIをクリックし、「有効にする」ボタンを押せば有効化は完了です。この時点ではまだAPIを呼び出すことはできませんが、次のステップで認証情報を作成することで利用可能になります。

認証情報の取得

APIを実際に使用するには、OAuth 2.0クライアントIDまたはサービスアカウントキーのいずれかの認証情報が必要です。個人利用であればOAuth 2.0、サーバー間通信やバッチ処理にはサービスアカウントが適しています。

認証情報は「APIとサービス」の「認証情報」メニューから作成できます。サービスアカウントを選択した場合は、JSONキーファイルをダウンロードして安全な場所に保管してください。

API設定時のチェックポイント

- Google Cloud Consoleで新規プロジェクトを作成したか

- Search Console APIを有効化したか

- 適切な認証方式を選択したか

- 認証情報(JSONキー)を安全に保管したか

サーチコンソールとの連携

サービスアカウントを使用する場合は、サーチコンソールの管理画面でユーザー追加が必要です。サービスアカウントのメールアドレスを、対象サイトの「制限付き」または「フル」権限を持つユーザーとして追加します。

この設定を忘れると、APIリクエストが認証エラーになってしまいます。サービスアカウントのメールアドレスは、作成時に自動生成されるので、メモしておくと便利です。

| 認証方式 | 用途 | 特徴 |

|---|---|---|

| OAuth 2.0 | 個人利用・対話型アプリ | ユーザー認証が必要 |

| サービスアカウント | サーバー間通信・自動化 | キーファイルで認証 |

認証情報の設定が完了すれば、いよいよAPIを使ったデータ取得に進めます。次のセクションでは、Pythonを使った具体的なデータ取得方法を解説します。

設定は最初だけの作業です。一度済ませてしまえば、あとはデータ取得に集中できますよ

バクヤスAI 記事代行では、

高品質な記事を圧倒的なコストパフォーマンスでご提供!

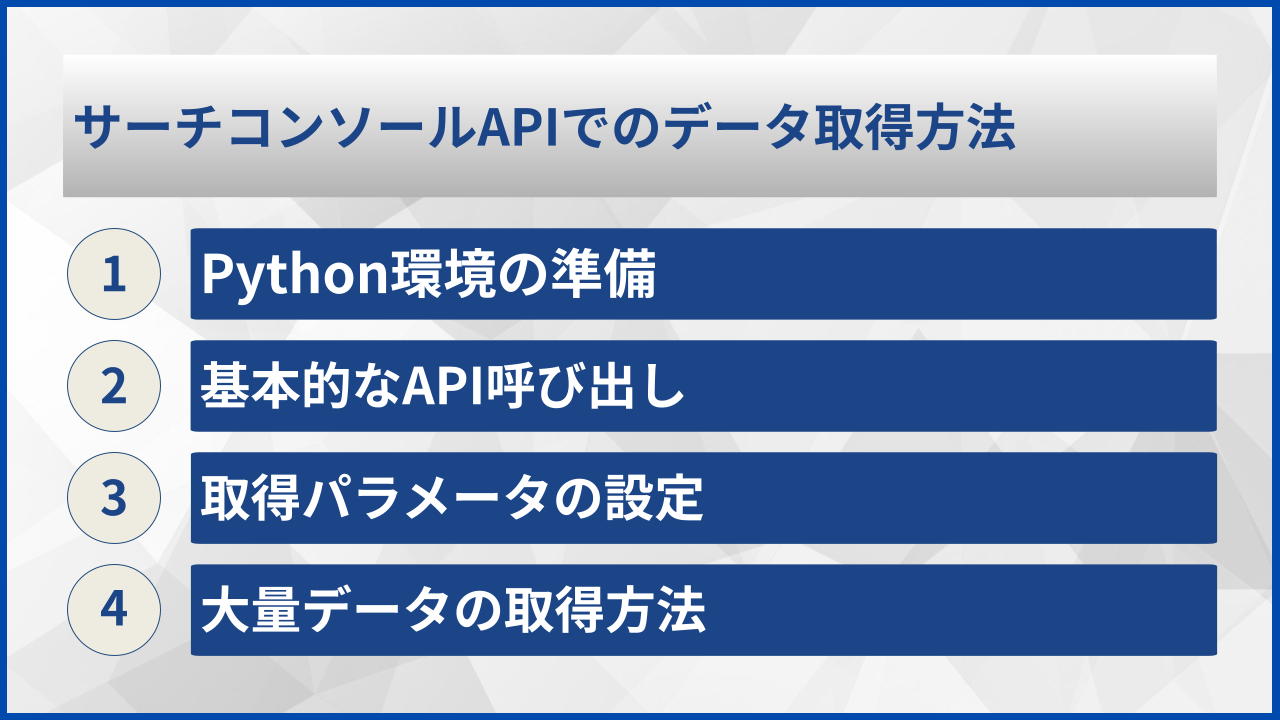

サーチコンソールAPIでのデータ取得方法

Python環境の準備

まずはPython環境にGoogle APIクライアントライブラリをインストールします。コマンドラインで「pip install google-api-python-client google-auth」を実行すれば、必要なパッケージが導入されます。

Python 3.7以上の環境を推奨します。仮想環境を作成して作業すると、他のプロジェクトとの依存関係の衝突を避けられます。

基本的なAPI呼び出し

サーチコンソールAPIの基本的な呼び出しは、認証→サービス構築→クエリ実行という流れで行います。サービスアカウントのJSONキーファイルを読み込み、Search Consoleサービスオブジェクトを生成します。

searchAnalytics.queryメソッドを使用することで、検索パフォーマンスデータを取得できます。リクエストボディには、取得期間、ディメンション、行数制限などのパラメータを指定します。

取得パラメータの設定

APIリクエストでは、startDate、endDate、dimensions、rowLimitなどのパラメータを適切に設定することが重要です。dimensionsには「query」「page」「device」「country」「date」などを指定できます。

複数のディメンションを組み合わせることで、より詳細な分析が可能になります。例えば、「query」と「page」を同時に指定すれば、どのキーワードでどのページが表示されているかが分かります。

| パラメータ | 説明 | 設定例 |

|---|---|---|

| startDate | 取得開始日 | 2024-01-01 |

| endDate | 取得終了日 | 2024-01-31 |

| dimensions | 分析軸 | query, page |

| rowLimit | 取得行数上限 | 25000 |

大量データの取得方法

APIには1リクエストあたり25,000行という制限がありますが、startRowパラメータを使ったページネーションで対応できます。最初のリクエストでstartRow=0、次のリクエストでstartRow=25000というように、順次取得していきます。

取得データが25,000行未満になるまでループ処理を繰り返すことで、大規模サイトの全データを取得できます。ただし、APIには日次の利用制限があるため、必要以上のリクエストは避けましょう。

データ取得時の確認ポイント

- 取得期間は適切に設定されているか

- 必要なディメンションを指定しているか

- rowLimitは25000以下になっているか

- ページネーション処理を実装しているか

データ取得ができるようになれば、次はそのデータをどのようにSEO施策に活用するかが重要になります。続いて、具体的な活用方法を見ていきましょう。

データ取得の自動化ができれば、分析作業に集中する時間が生まれます

バクヤスAI 記事代行では、高品質な記事を圧倒的なコストパフォーマンスでご提供!

バクヤスAI 記事代行では、SEOの専門知識と豊富な実績を持つ専任担当者が、キーワード選定からAIを活用した記事作成、人の目による品質チェック、効果測定までワンストップでご支援いたします。

ご興味のある方は、ぜひ資料をダウンロードして詳細をご確認ください。

サービス導入事例

株式会社ヤマダデンキ 様

生成AIの活用により、以前よりも幅広いキーワードで、迅速にコンテンツ作成をすることが可能になりました。

親身になって相談に乗ってくれるTechSuiteさんにより、とても助かっております。

▶バクヤスAI 記事代行導入事例を見る

SEO分析への活用術

キーワード分析の実践

取得したクエリデータを分析することで、想定外のキーワードでの流入や、狙い目のキーワードを発見できます。表示回数が多いのにクリック率が低いキーワードは、タイトルやメタディスクリプションの改善で成果が期待できます。

また、順位が11〜20位のキーワードは、少しの改善で1ページ目に表示される可能性があります。このような「あと一歩」のキーワードを優先的に対策することで、効率的にトラフィックを増やせます。

ページパフォーマンス評価

ページ単位での分析では、各URLのクリック数、表示回数、CTR、平均順位を時系列で追跡します。順位は維持しているのにクリック数が減少している場合、検索意図の変化や競合の台頭が考えられます。

逆に、順位が下がってもクリック数が維持されているページは、ブランド検索や指名検索で支えられている可能性があります。このような分析から、各ページの役割や改善優先度を判断できます。

| 分析パターン | データの特徴 | 推奨アクション |

|---|---|---|

| 表示多・CTR低 | 露出はあるが選ばれない | タイトル・説明文改善 |

| 順位11-20位 | 2ページ目に表示 | コンテンツ強化 |

| 順位安定・クリック減 | 検索ニーズの変化 | コンテンツ更新 |

| 新規クエリ増加 | 新たな検索需要 | 関連コンテンツ作成 |

レポート自動化の構築

APIを活用したレポート自動化により、週次や月次の定点観測を効率化できます。Pythonスクリプトをcronやタスクスケジューラで定期実行し、結果をスプレッドシートやBIツールに出力する仕組みを構築します。

レポートには、主要KPIの推移、順位変動の大きいキーワード、新規で表示されたクエリなどを含めると有用です。自動化により、データ収集の手間を省き、分析と施策立案に時間を使えるようになります。

データ可視化の手法

取得データをグラフやダッシュボードで可視化することで、傾向やパターンを直感的に把握できます。Google Data Studio(Looker Studio)やTableauなどのBIツールと連携させれば、リアルタイムに近いデータ可視化も可能です。

時系列グラフでトレンドを把握し、散布図でCTRと順位の関係を分析するなど、目的に応じた可視化を行いましょう。チーム内での情報共有にも、可視化されたデータは効果的です。

SEO分析で確認すべき指標

- 表示回数とクリック率のバランス

- 順位変動の傾向と要因

- 新規クエリの出現状況

- デバイス別のパフォーマンス差

これらの分析手法を組み合わせることで、データに基づいた効果的なSEO施策が実現できます。定期的な分析と改善のサイクルを回していくことが重要です。

データは取得するだけでなく、施策に繋げてこそ価値があります。分析の習慣化を目指しましょう

API利用時の注意点

利用制限への対応

サーチコンソールAPIには、1日あたりのリクエスト数や1リクエストあたりの取得行数に制限があります。無料枠では1日あたり約1,200リクエストまでとなっており、大規模な利用には計画的なリクエスト管理が必要です。

制限を超えそうな場合は、取得頻度を調整したり、必要なデータのみを取得するよう絞り込んだりする工夫が求められます。エラーレスポンスを監視し、制限に達した場合は自動的にリトライする仕組みを実装しておくと安心です。

セキュリティ対策

認証情報(JSONキーファイル)の管理には細心の注意を払う必要があります。キーファイルをGitHubなどの公開リポジトリにアップロードしてしまうと、第三者にアカウントを悪用される可能性があります。

環境変数を使ってキー情報を管理したり、キーファイルを.gitignoreに追加したりするなどの対策を行いましょう。定期的にキーをローテーションすることも、セキュリティ向上に効果的です。

データ精度の理解

APIで取得するデータには、サンプリングやフィルタリングが適用されている場合があります。極端に少ないクリック数やインプレッション数のデータは、プライバシー保護の観点から集計対象外となることがあります。

そのため、取得データを絶対的な数値として扱うのではなく、傾向把握や相対比較の材料として活用することが適切です。管理画面の数値と完全に一致しない場合もあることを理解しておきましょう。

| 注意点 | リスク | 対策 |

|---|---|---|

| 利用制限 | リクエスト失敗 | 計画的な取得設計 |

| 認証情報漏洩 | 不正アクセス | 適切なキー管理 |

| データ精度 | 誤った判断 | 傾向分析として活用 |

| API仕様変更 | スクリプト停止 | 公式ドキュメント確認 |

これらの注意点を意識しながら運用することで、サーチコンソールAPIを安全かつ効果的に活用できます。定期的に公式ドキュメントを確認し、仕様変更にも対応していきましょう。

制限やセキュリティを理解した上で運用すれば、長期的にAPIを活用できるはずです!

よくある質問

- サーチコンソールAPIは無料で使えますか

-

はい、サーチコンソールAPIは基本的に無料で利用できます。Google Cloud Platformの無料枠内であれば、追加費用は発生しません。ただし、1日あたりのリクエスト数には制限があるため、大規模な利用を検討している場合は有料プランへの移行も視野に入れておくとよいでしょう。

- プログラミング知識がなくてもAPIは使えますか

-

基本的にはPythonなどのプログラミング言語の知識が必要です。ただし、Google Apps ScriptやZapierなどのノーコードツールを活用することで、プログラミング経験がなくてもある程度の自動化は実現できます。より高度な分析を行いたい場合は、Pythonの基礎を学ぶことをおすすめします。

- APIで取得したデータと管理画面の数値が異なるのはなぜですか

-

サンプリングやプライバシー保護のためのフィルタリングが原因で、数値に差が生じることがあります。特に少量のデータは集計から除外される場合があります。APIデータは絶対値としてではなく、傾向把握や相対的な比較の材料として活用することが適切です。

- 複数のサイトのデータを一括で取得できますか

-

はい、可能です。サービスアカウントを各サイトのユーザーとして追加しておけば、一つのスクリプトから複数サイトのデータを順次取得できます。サイトURLをリスト化してループ処理することで、効率的な一括取得が実現できます。

まとめ

サーチコンソールAPIは、SEOデータの取得と分析を自動化するための強力なツールです。Google Cloud Consoleでの設定から始まり、Pythonなどのプログラミング言語を使ってデータを取得し、分析に活用できます。

APIを活用することで、手動では困難な大量データの取得や定期的なレポート作成が可能になります。クリック率の改善ポイントや順位上昇の可能性があるキーワードを効率的に発見し、データドリブンなSEO施策を実現できます。

利用制限やセキュリティ面での注意点を理解した上で、まずは小規模な自動化から始めてみてください。継続的なデータ活用により、Webサイトの検索パフォーマンス向上に繋げていただければ幸いです。